Node.js Uygulamalarında Mikroservisler Arası İletişim Stratejileri: Mesaj Kuyrukları ve gRPC ile Sağlam Sistemler Kurun

Modern yazılım mimarilerinde mikroservisler, uygulamaların esnekliğini ve ölçeklenebilirliğini artırmak için merkezi bir rol oynar. Ancak bir uygulamayı küçük, bağımsız servis parçalarına böldüğümüzde, bu servislerin birbirleriyle nasıl etkileşim kuracağı sorunu ortaya çıkar. Dağıtık bir sistemde, servisler arası iletişim; performansı, dayanıklılığı ve genel sistem sağlığını doğrudan etkileyen en kritik unsurlardan biridir.

Benim geliştirme tecrübelerimde, özellikle Node.js ile inşa ettiğimiz yüksek performanslı ve eşzamanlı uygulamalarda, servisler arası iletişim stratejisini doğru seçmenin projenin başarısı için ne kadar hayati olduğunu defalarca gözlemledim. Node.js'in asenkron, olay tabanlı yapısı, bu tür iletişim mekanizmalarını tasarlamak ve uygulamak için benzersiz avantajlar sunar. Bu yazıda, Node.js tabanlı mikroservisleriniz arasında kullanabileceğiniz farklı iletişim stratejilerini – RESTful API'lerden mesaj kuyruklarına ve yüksek performanslı gRPC'ye kadar – derinlemesine inceleyeceğiz. Amacımız, uygulamanız için en uygun ve sağlam iletişim modelini seçmenize yardımcı olmak.

Mikroservis İletişiminin Önemi ve Zorlukları

Daha önceki Node.js ile Ölçeklenebilir Mikroservisler yazımda bahsettiğim gibi, mikroservis mimarisi birçok fayda sağlarken, beraberinde bazı zorlukları da getirir. Bu zorlukların başında, bağımsız servislerin tutarlı ve güvenilir bir şekilde haberleşmesini sağlamak gelir. Geleneksel monolitik uygulamalarda fonksiyon çağrıları kolay ve güvenilirken, dağıtık sistemlerde ağ gecikmeleri, servis hataları ve veri tutarsızlıkları gibi sorunlarla karşılaşmak olasıdır.

Mikroservis İletişiminin Temel Hedefleri:

- Güvenilirlik: Mesajların kaybolmaması ve doğru servise ulaşması.

- Performans: Düşük gecikme süresi ve yüksek verim.

- Ölçeklenebilirlik: Artan yük altında bile iletişimin sorunsuz devam etmesi.

- Dayanıklılık: Bir servisin çökmesinin tüm sistemi etkilememesi.

- Gevşek Bağlılık (Loose Coupling): Servislerin birbirleri hakkında minimum bilgiye sahip olması.

1. Senkron İletişim: RESTful API'ler

Mikroservisler arasında iletişim kurmanın en yaygın ve tanıdık yollarından biri RESTful API'lerdir. Bir servis (istemci), diğer bir servisin (sunucu) belirlediği bir HTTP endpoint'ine istek gönderir ve yanıt bekler. Bu model, kolay anlaşılır olması ve tarayıcılar tarafından da desteklenmesi nedeniyle sıkça tercih edilir.

Avantajları:

- Basitlik ve Tanıdıklık: Geliştiricilerin çoğu HTTP ve REST prensiplerine aşinadır.

- Esneklik: JSON veya XML gibi farklı veri formatlarını destekler.

- Hızlı Geliştirme: Hızla API endpoint'leri oluşturulabilir.

Dezavantajları:

- Sıkı Bağlılık: İstemci servis, sunucu servisin adresini ve API sözleşmesini bilmek zorundadır. Sunucu servisi çevrimdışı olduğunda istemci hata alır.

- Senkron Bloklama: İstek gönderen servis, yanıt gelene kadar beklemek zorunda kalır. Bu durum, uzun süren işlemler veya yüksek trafik altında darboğazlara yol açabilir.

- Şelale Hataları (Cascading Failures): Bir servisteki hata, o servise bağımlı olan diğer servislerin de hata vermesine neden olabilir.

- Ağ Gecikmesi: Her istek-yanıt döngüsü ağ gecikmelerine tabidir.

Node.js ile Basit Bir RESTful İletişim Örneği:

Node.js'te Express.js gibi framework'ler ile REST API oluşturmak oldukça basittir.

// User Service (Sunucu)

const express = require('express');

const app = express();

const port = 3001;

app.get('/users/:id', (req, res) => {

// Veritabanından kullanıcı çekme mantığı

console.log(`Kullanıcı ${req.params.id} istendi`);

res.json({ id: req.params.id, name: 'İsmail YAĞCI', email: 'ismailyagci371@gmail.com' });

});

app.listen(port, () => console.log(`User Service ${port} üzerinde çalışıyor`));

// Product Service (İstemci)

const fetch = require('node-fetch'); // Ya da Axios

async function getUserById(userId) {

try {

const response = await fetch(`http://localhost:3001/users/${userId}`);

if (!response.ok) {

throw new Error(`HTTP hata! Durum: ${response.status}`);

}

const user = await response.json();

console.log('Alınan kullanıcı:', user);

return user;

} catch (error) {

console.error('Kullanıcı çekilirken hata:', error.message);

}

}

getUserById(123);2. Asenkron İletişim: Mesaj Kuyrukları (Message Queues)

Senkron iletişimin dezavantajlarını gidermek ve servisler arasında daha gevşek bağlı bir yapı oluşturmak için asenkron iletişim modelleri, özellikle mesaj kuyrukları kullanılır. Bu yaklaşımda, servisler doğrudan birbirleriyle haberleşmek yerine, mesajları merkezi bir mesaj broker'ına (kuyruğa) gönderirler. Diğer servisler de bu kuyruklardan mesajları dinleyerek veya çekerek işler.

Avantajları:

- Gevşek Bağlılık: Servisler birbirlerinin varlığından haberdar olmak zorunda değildir; sadece mesaj formatını ve kuyruğu bilmeleri yeterlidir.

- Dayanıklılık ve Hata Toleransı: Bir servis çevrimdışı olsa bile, mesajlar kuyrukta bekler ve servis tekrar çalışır hale geldiğinde işlenebilir.

- Ölçeklenebilirlik: Mesaj işleyici servislerin sayısı artırılabilir veya azaltılabilir. Üretici ve tüketici servisleri farklı hızlarda çalışabilir.

- Asenkron İşleme: İstek gönderen servis, yanıt beklemeden kendi işine devam edebilir.

- Olay Odaklı Mimari (Event-Driven Architecture): Servisler, sistemdeki belirli olaylara tepki verecek şekilde tasarlanabilir.

Popüler Mesaj Kuyruğu Çözümleri:

a) RabbitMQ

Gelişmiş mesaj yönlendirme yetenekleri, farklı mesajlaşma desenlerini (Work Queues, Publish/Subscribe, Routing, Topics) desteklemesi ve sağlamlığı ile bilinir. Karmaşık yönlendirme mantığına ihtiyaç duyan senaryolar için idealdir.

// RabbitMQ ile basit bir "mesaj gönder ve al" örneği (Conceptual)

// Üretici (Producer) Service

const amqp = require('amqplib');

async function sendOrder(orderData) {

const connection = await amqp.connect('amqp://localhost');

const channel = await connection.createChannel();

const queue = 'order_queue';

await channel.assertQueue(queue, { durable: false });

channel.sendToQueue(queue, Buffer.from(JSON.stringify(orderData)));

console.log('Sipariş gönderildi:', orderData);

setTimeout(() => { connection.close(); }, 500);

}

sendOrder({ orderId: 'ORD001', amount: 150 });

// Tüketici (Consumer) Service

async function consumeOrders() {

const connection = await amqp.connect('amqp://localhost');

const channel = await connection.createChannel();

const queue = 'order_queue';

await channel.assertQueue(queue, { durable: false });

console.log('Siparişler bekleniyor...');

channel.consume(queue, (msg) => {

const order = JSON.parse(msg.content.toString());

console.log('Sipariş alındı ve işleniyor:', order);

// Sipariş işleme mantığı

}, { noAck: true });

}

consumeOrders();b) Kafka

Yüksek hacimli, gerçek zamanlı veri akışları ve log toplama için tasarlanmıştır. Dağıtık, kalıcı ve yatay olarak ölçeklenebilir bir olay akışı platformudur. Özellikle büyük veri uygulamaları ve olay kaynaklı mimarilerde tercih edilir.

div data-gjs-type="image_placeholder">Mesaj Kuyrukları Ne Zaman Kullanılmalı?

- Servisler arasında güçlü bir gevşek bağlılık istendiğinde.

- Uzun süreli veya arka plan işlemleri olduğunda.

- Gerçek zamanlı olay akışları ve veri senkronizasyonu gerektiğinde (Kafka).

- Yüksek verim ve dayanıklılık önemli olduğunda.

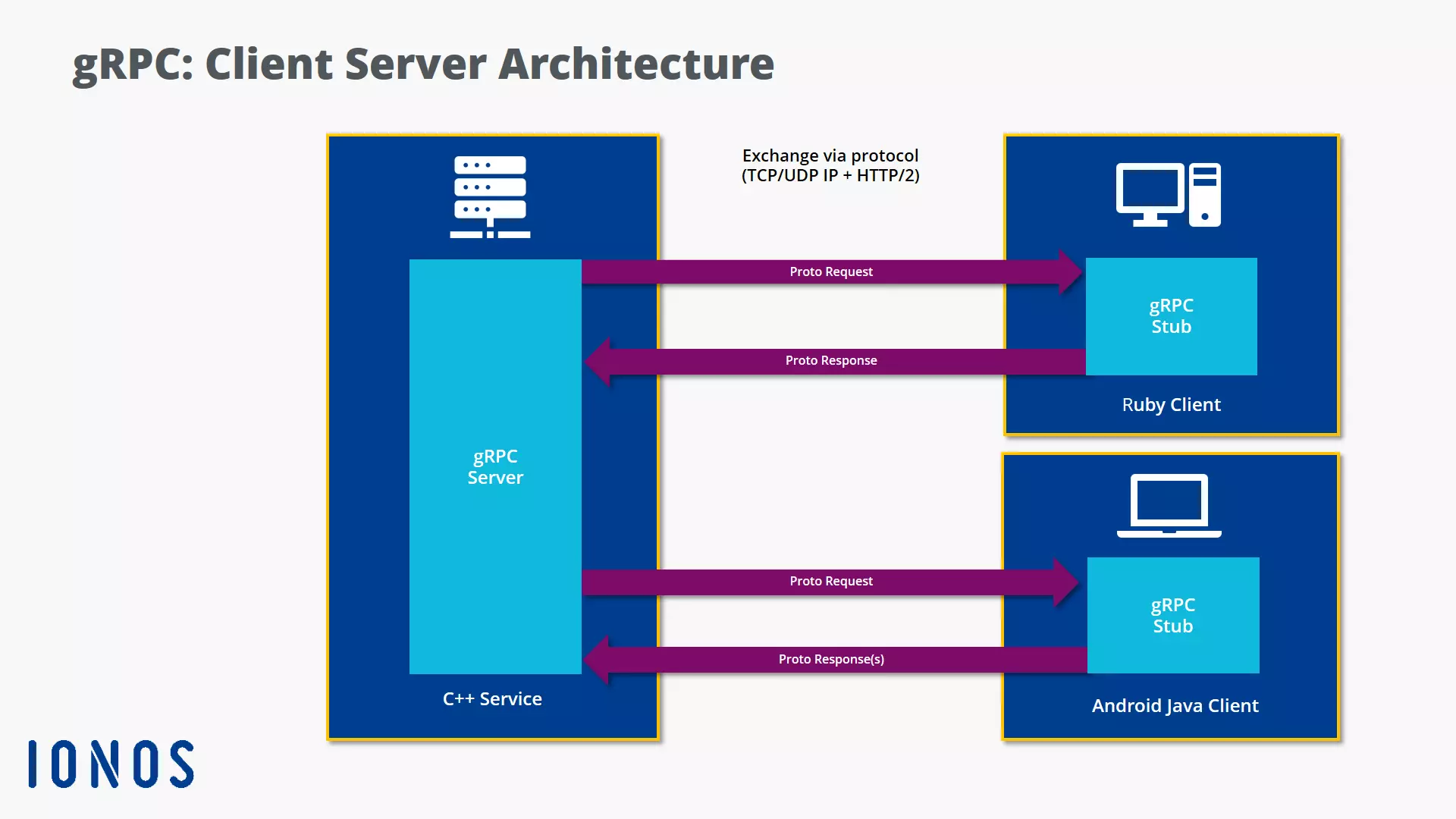

3. Yüksek Performanslı RPC: gRPC

gRPC (Google Remote Procedure Call), Google tarafından geliştirilen modern, yüksek performanslı bir RPC (Remote Procedure Call) framework'üdür. HTTP/2 üzerine inşa edilmiştir ve Protocol Buffers (Protobuf) adı verilen ikili bir serileştirme mekanizması kullanır. Bu sayede, REST'e göre daha küçük mesaj boyutları ve daha hızlı iletişim sağlar.

Avantajları:

- Yüksek Performans: HTTP/2 ve Protobuf sayesinde düşük gecikme ve yüksek verim.

- Otomatik Kod Üretimi: `proto` dosyaları kullanılarak client ve server kodları otomatik olarak üretilir, bu da hata oranını azaltır ve geliştirme hızını artırır.

- Çoklu Dil Desteği: Farklı dillerde yazılmış servislerin kolayca birbiriyle iletişim kurmasını sağlar.

- Client-side ve Server-side Streaming: Tek yönlü veya çift yönlü akış tabanlı iletişim yetenekleri sunar (örneğin, gerçek zamanlı bildirimler veya büyük dosya yüklemeleri için).

- Sıkı Tip Denetimi: `proto` tanımlamaları sayesinde veri tipleri compile zamanında kontrol edilir.

Dezavantajları:

- Öğrenme Eğrisi: Protobuf ve gRPC'nin kendine özgü kavramları vardır.

- Tarayıcı Desteği: Doğrudan tarayıcı desteği yoktur (gRPC-Web gibi proxy katmanları gerekir).

- İnsan Tarafından Okunabilirlik: İkili format olduğu için mesajlar doğrudan okunamaz.

Node.js ile gRPC Örneği (Kavramsal):

gRPC karmaşık bir konu olduğu için burada tam bir kod örneği yerine kavramsal bir yaklaşım sunacağım. Bir `proto` dosyası tanımlayarak başlarsınız:

// hero.proto

syntax = "proto3";

package hero;

service HeroService {

rpc GetHero (HeroId) returns (Hero) {}

rpc ListHeroes (Empty) returns (HeroList) {}

}

message HeroId {

int32 id = 1;

}

message Hero {

int32 id = 1;

string name = 2;

string superpower = 3;

}

message HeroList {

repeated Hero heroes = 1;

}

message Empty {}Bu `proto` dosyasından Node.js için gerekli servis arayüzleri ve veri yapıları otomatik olarak oluşturulur. Ardından server ve client kodunu yazarsınız:

// gRPC Server (Node.js)

const grpc = require('@grpc/grpc-js');

const protoLoader = require('@grpc/proto-loader');

const PROTO_PATH = './hero.proto';

const packageDefinition = protoLoader.loadSync(PROTO_PATH);

const hero_proto = grpc.loadPackageDefinition(packageDefinition).hero;

const server = new grpc.Server();

server.addService(hero_proto.HeroService.service, {

GetHero: (call, callback) => {

console.log('GetHero çağrıldı:', call.request.id);

// DB'den hero çekme mantığı

callback(null, { id: call.request.id, name: 'Superman', superpower: 'Flight' });

},

ListHeroes: (call, callback) => {

// DB'den tüm heroları çekme mantığı

callback(null, { heroes: [{ id: 1, name: 'Batman', superpower: 'Money' }] });

}

});

server.bindAsync('0.0.0.0:50051', grpc.ServerCredentials.createInsecure(), () => {

server.start();

console.log('gRPC sunucusu 50051 üzerinde çalışıyor');

});

// gRPC Client (Node.js)

const client = new hero_proto.HeroService('localhost:50051', grpc.credentials.createInsecure());

client.GetHero({ id: 1 }, (error, hero) => {

if (error) console.error(error);

console.log('gRPC ile alınan hero:', hero);

});gRPC Ne Zaman Kullanılmalı?

- Performans kritik, düşük gecikmeli iletişim gerektiğinde.

- Farklı dillerde yazılmış servisler arasında iletişim kurulduğunda.

- Akış (streaming) tabanlı iletişim senaryolarında.

- Sıkı tip denetimi ve otomatik kod üretimi avantajları istendiğinde.

Doğru İletişim Stratejisini Seçmek

Her iletişim stratejisinin kendine özgü avantajları ve dezavantajları vardır. Uygulamanızın ihtiyaçlarına göre doğru seçimi yapmak kritik öneme sahiptir:

- Basit CRUD işlemleri, hızlı yanıtlar ve tarayıcı entegrasyonu gerektiren senaryolar için: RESTful API'ler idealdir.

- Servisler arası gevşek bağlılık, arka plan işlemleri, olay odaklı mimari ve yüksek hata toleransı için: Mesaj kuyrukları (RabbitMQ, Kafka) tercih edilmelidir.

- Yüksek performans, düşük gecikme, akış tabanlı iletişim ve çoklu dil desteği gerektiğinde: gRPC mükemmel bir seçenektir.

Genellikle karmaşık mikroservis mimarileri, bu stratejilerin bir kombinasyonunu kullanır. Örneğin, kullanıcı arayüzünden gelen istekler için REST, servisler arası asenkron olaylar için mesaj kuyrukları ve dahili, performans kritik servisler arası iletişim için gRPC kullanılabilir.

Sık Karşılaşılan Zorluklar ve Çözümleri

- Dağıtık İşlemler ve Veri Tutarlılığı: Asenkron iletişimde birden fazla servis arasında veri tutarlılığını sağlamak zorlayıcı olabilir. Event Sourcing & CQRS gibi desenler veya Saga paterni bu soruna çözüm sunabilir.

- Hata Yönetimi ve Yeniden Deneme Mekanizmaları: Dağıtık sistemlerde ağ hataları veya servis kesintileri kaçınılmazdır. Hata yönetimini etkin bir şekilde uygulamak, yeniden deneme (retry) mekanizmaları ve devre kesici (circuit breaker) desenleri kullanmak sistem dayanıklılığını artırır. Bu konuda Node.js ve Express.js'te Güçlü Hata Yönetimi yazıma da göz atabilirsiniz.

- İzlenebilirlik (Observability): Bir isteğin birden fazla servisten geçtiği durumlarda, isteğin akışını izlemek ve performans darboğazlarını tespit etmek için dağıtık izleme (distributed tracing) araçları (Jaeger, Zipkin) ve merkezi loglama sistemleri hayati öneme sahiptir. Daha fazla bilgi için Node.js Uygulamalarında İzleme ve Hata Ayıklama yazımı okuyabilirsiniz.

Sonuç

Node.js, mikroservis mimarisinde güçlü ve esnek iletişim stratejileri geliştirmek için mükemmel bir platform sunar. RESTful API'ler, mesaj kuyrukları (RabbitMQ, Kafka) ve gRPC gibi farklı yöntemler, uygulamanızın özel gereksinimlerine göre seçildiğinde, ölçeklenebilir, dayanıklı ve yüksek performanslı sistemler oluşturmanıza olanak tanır.

Unutmayın, her teknolojinin kendi kullanım durumu ve ödünleşimleri vardır. Önemli olan, projenizin mevcut ve gelecekteki ihtiyaçlarını doğru analiz ederek en uygun iletişim modelini belirlemektir. Bu stratejileri birleştirerek, mikroservislerinizin potansiyelini en üst düzeye çıkarabilir ve kullanıcılarınıza kesintisiz bir deneyim sunabilirsiniz.

Eğer aklınıza takılan sorular olursa veya bu konular hakkında daha fazla bilgi almak isterseniz, bana ismailyagci371@gmail.com adresinden veya sosyal medya kanallarımdan (İsmail YAĞCI) ulaşabilirsiniz. Sağlıklı ve başarılı kodlamalar dilerim!

Yorumlar

Yorum Gönder